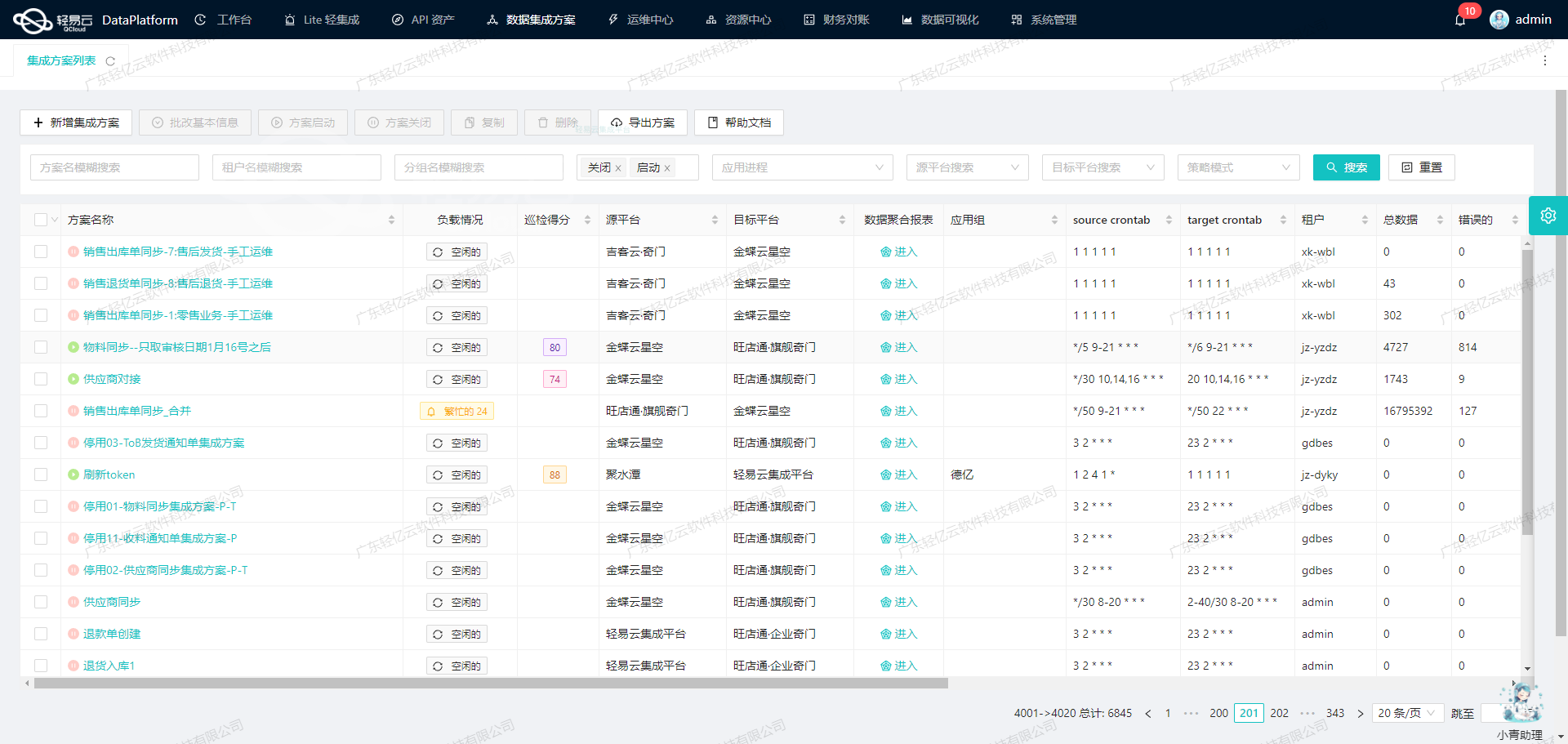

案例分享:金蝶云星辰V2数据集成到轻易云集成平台

在实际的企业应用场景中,系统间的数据对接与集成常常遇到诸多挑战。本文将具体探讨如何通过轻易云数据集成平台实现对金蝶云星辰V2客户数据的无缝对接,并确保整个过程高效、可靠、安全。

查询金蝶客户闽康益生菌方案概述

项目需求明确,即从金蝶云星辰V2获取特定客户——闽康益生菌的数据,并令其顺利集成至轻易云集成平台。在这个过程中,我们不仅要解决API调用、分页处理、限流等技术问题,还需应对两套系统之间可能存在的数据格式差异。

确保不漏单的抓取策略

首先,通过/jdy/v2/bd/customer接口稳定地获取目标客户信息。为确保数据完整性,使用了定时任务来调度API调用,以批量方式抓取最新更新和新增记录。同时,为应对分页返回机制,对每次读取操作进行严格监控和日志记录,在出现异常时能够迅速重试并修正错误。

大量数据快速写入方法

在数据成功提取后,需要将其高效地写入到轻易云平台。我们采取了批量操作模式,充分利用轻易云提供的大容量、高吞吐能力。此外,通过专门设计的数据映射函数,将原始API返回结果转换为目标格式,有效解决了两者间的格式不一致问题,使得大量业务数据能够顺利完成跨系统传输。

实时监控与日志管理

为了保证整个流程透明可追溯,每一步操作均配置了实时监控和详细日志记录功能,从而实现全生命周期内各环节状态的即时掌握。这样,不仅可以及时发现并调整潜在的问题,还有助于提高整体运作效率及业务决策分析效果。

主要技术点解析:

-

调用API

/jdy/v2/bd/customer获取指定客户资料:精确控制参数,实现精准查询。 -

分页处理与限流控制:细粒度分步获取大规模数据库内容,同时避免触发服务端阻塞或超载。

-

批量写入至轻易云平台:利用平行多线程及缓冲队列优化上传速度与性能。

-

错误重试机制设计:针对网络波动或服务端偶发故障,引入自动检测及循环重试逻辑,强化流程鲁棒性。

以上就是本案例实施中的一些关键步骤和核心技术要点介绍。在后续章节中,我们将进一步深入探

调用金蝶云星辰V2接口获取并加工客户数据

在数据集成的生命周期中,调用源系统接口获取数据是至关重要的第一步。本文将详细探讨如何通过轻易云数据集成平台调用金蝶云星辰V2接口/jdy/v2/bd/customer,并对获取的数据进行加工处理。

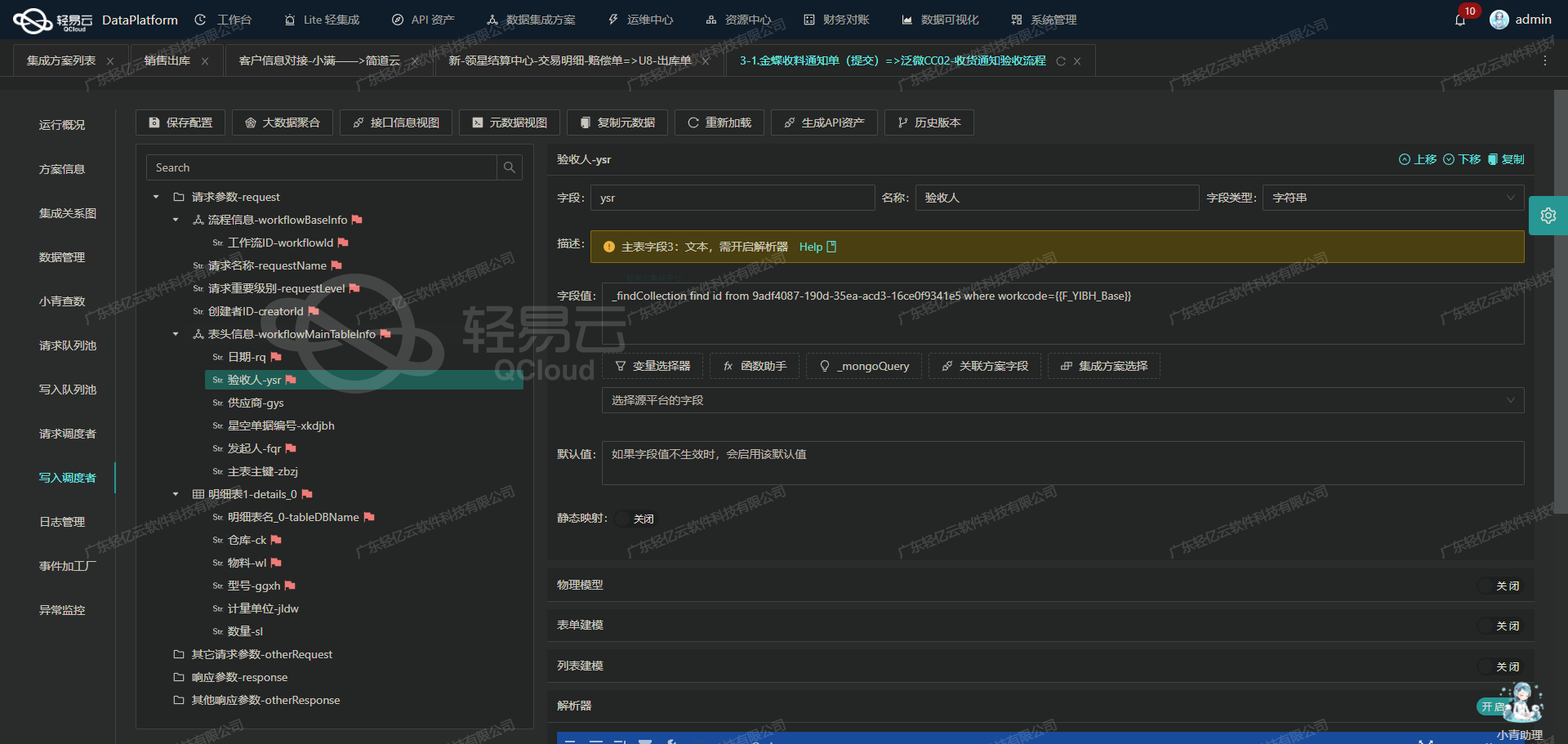

接口调用配置

首先,我们需要配置元数据以便正确调用金蝶云星辰V2的API接口。以下是元数据配置的详细信息:

{

"api": "/jdy/v2/bd/customer",

"effect": "QUERY",

"method": "GET",

"number": "number",

"id": "id",

"name": "number",

"idCheck": true,

"request": [

{

"field": "modify_end_time",

"label": "修改时间-结束时间的时间戳(毫秒)",

"type": "string",

"describe": "修改时间-结束时间的时间戳(毫秒)",

"value": "_function {CURRENT_TIME}*1000"

},

{

"field": "modify_start_time",

"label": "修改时间-开始时间的时间戳(毫秒)",

"type": "string",

"describe": "修改时间-开始时间的时间戳(毫秒)",

"value": "_function {LAST_SYNC_TIME}*1000"

},

{

"field": "page",

"label": "当前页,默认1",

"type": "string",

"describe": "当前页,默认1",

"value": "1"

},

{

"field": "page_size",

"label": "每页显示条数,默认10",

"type": "string",

"describe": "每页显示条数,默认10",

"$value$":"50"

}

]

}请求参数解析

- modify_end_time: 修改结束时间的时间戳(毫秒),通过函数

_function {CURRENT_TIME}*1000动态获取当前系统时间。 - modify_start_time: 修改开始时间的时间戳(毫秒),通过函数

_function {LAST_SYNC_TIME}*1000动态获取上次同步的时间。 - page: 当前页码,默认为1。

- page_size: 每页显示条数,默认为50。

这些参数确保了我们能够灵活地查询特定时间段内的数据,并分页处理大量数据。

API调用与数据清洗

在配置好请求参数后,我们可以通过GET方法调用API接口。以下是一个示例请求:

GET /jdy/v2/bd/customer?modify_start_time=1633046400000&modify_end_time=1633132800000&page=1&page_size=50

Host: api.kingdee.com

Authorization: Bearer <access_token>假设返回的数据格式如下:

{

"code": 200,

"$data$":[

{

"$id$":"12345",

"$number$":"C001",

"$name$":"闽康益生菌"

},

...

]

}数据加工处理

获取到原始数据后,我们需要对其进行清洗和转换,以便后续写入目标系统。以下是一个简单的数据清洗示例:

import json

def clean_data(raw_data):

cleaned_data = []

for item in raw_data['data']:

cleaned_record = {

'customer_id': item['id'],

'customer_number': item['number'],

'customer_name': item['name']

}

cleaned_data.append(cleaned_record)

return cleaned_data

# 示例原始数据

raw_data = {

"$data$":[

{"$id$":"12345", "$number$":"C001", "$name$":"闽康益生菌"},

...

]

}

cleaned_data = clean_data(raw_data)

print(json.dumps(cleaned_data, indent=4))上述代码将原始数据中的字段重新映射为更易于理解和使用的字段名称,并生成一个新的清洗后的数据列表。

总结

通过轻易云数据集成平台,我们能够高效地调用金蝶云星辰V2接口获取客户数据,并对其进行必要的清洗和转换。这一过程不仅提升了业务透明度,还确保了数据的一致性和准确性。在实际应用中,可以根据具体需求进一步优化和扩展此流程,以满足更多复杂场景下的数据集成需求。

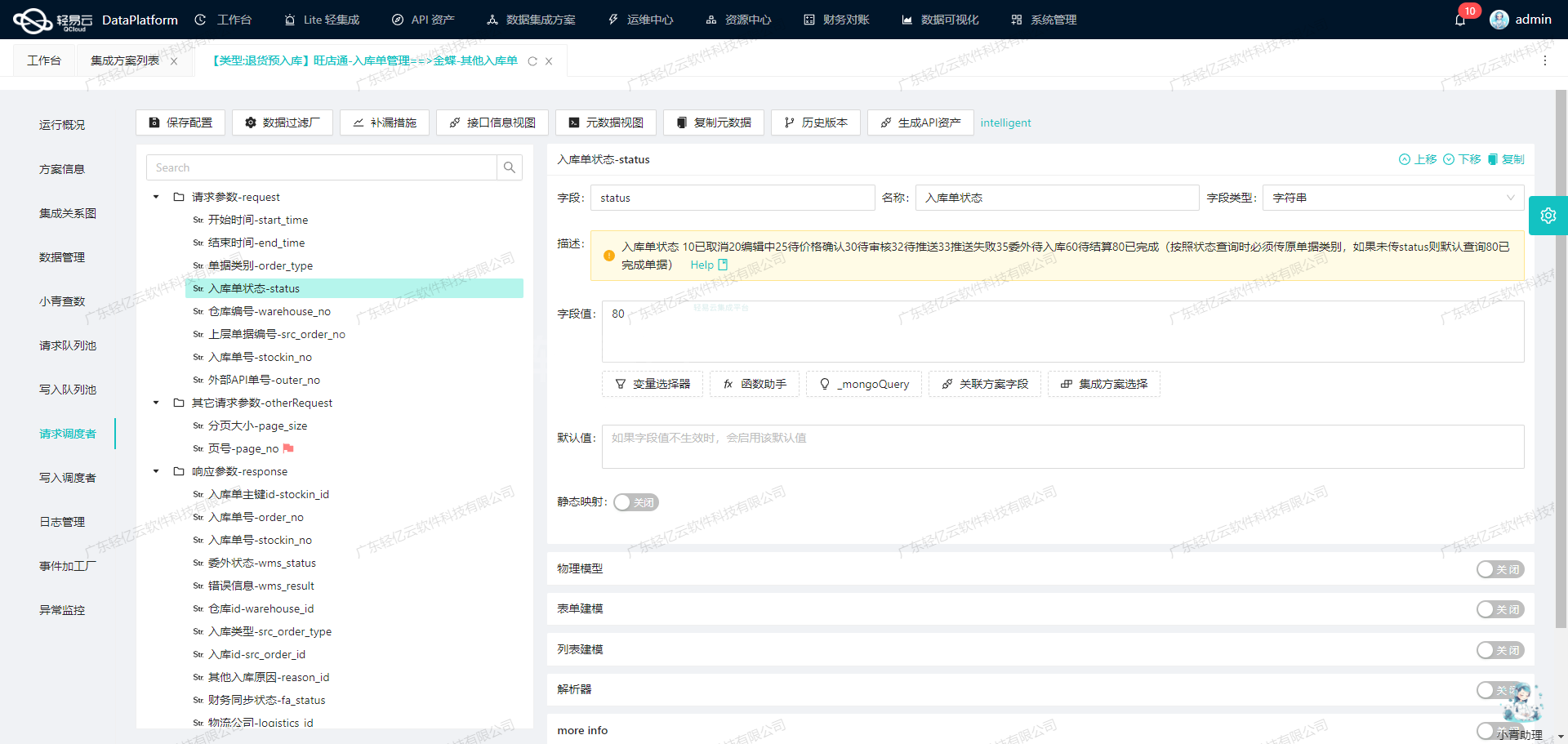

使用轻易云数据集成平台进行ETL转换与写入的技术案例

在数据集成生命周期的第二步,我们需要将已经集成的源平台数据进行ETL转换,并转为目标平台能够接收的格式,最终写入目标平台。本文将通过一个具体的技术案例,详细探讨如何使用轻易云数据集成平台实现这一过程。

数据请求与清洗

首先,我们从金蝶系统中查询客户闽康益生菌的数据。假设我们已经完成了数据请求和初步清洗,获得了以下结构的数据:

{

"customerId": "12345",

"customerName": "闽康益生菌",

"contactInfo": {

"phone": "1234567890",

"email": "example@example.com"

},

"address": {

"province": "福建省",

"city": "厦门市",

"district": "思明区",

"detailAddress": "某某路某某号"

}

}数据转换

接下来,我们需要对上述数据进行ETL转换,使其符合轻易云集成平台API接口所能接收的格式。假设目标平台要求的数据格式如下:

{

"id": "12345",

"name": "闽康益生菌",

"contact_phone": "1234567890",

"contact_email": "example@example.com",

"location": {

"province": "福建省",

"city": "厦门市",

"district": "思明区",

"address_detail": "某某路某某号"

}

}为此,我们可以编写一个ETL脚本,将源数据转换为目标格式:

def transform_data(source_data):

transformed_data = {

'id': source_data['customerId'],

'name': source_data['customerName'],

'contact_phone': source_data['contactInfo']['phone'],

'contact_email': source_data['contactInfo']['email'],

'location': {

'province': source_data['address']['province'],

'city': source_data['address']['city'],

'district': source_data['address']['district'],

'address_detail': source_data['address']['detailAddress']

}

}

return transformed_data

source_data = {

# 源数据内容

}

transformed_data = transform_data(source_data)数据写入

在完成数据转换后,我们需要将转换后的数据写入目标平台。根据元数据配置,目标平台API接口信息如下:

{

"api":"写入空操作",

"effect":"EXECUTE",

"method":"POST",

"idCheck":true

}我们可以使用Python的requests库来实现这一操作:

import requests

def write_to_target_platform(data):

url = "<目标平台API地址>/写入空操作"

headers = {

'Content-Type': 'application/json'

}

response = requests.post(url, json=data, headers=headers)

if response.status_code == 200:

print("Data written successfully")

else:

print(f"Failed to write data: {response.status_code}, {response.text}")

write_to_target_platform(transformed_data)在上述代码中,我们首先定义了一个函数write_to_target_platform,该函数接受转换后的数据作为参数,并使用POST方法将其发送到目标平台API接口。如果响应状态码为200,则表示数据成功写入;否则,将打印错误信息。

小结

通过上述步骤,我们展示了如何使用轻易云数据集成平台完成从源系统到目标系统的数据ETL转换与写入。在实际应用中,可以根据具体需求进一步优化和扩展这些步骤,以确保数据集成过程高效、可靠。